@邹扒皮.com

@mdjxyz

Followers

913

Following

737

Media

149

Statuses

1,703

云计算仁波切 顺义分切| 练习时长两年半的 K8S 练习生| 现 在线教育客服| 前 大象卷王| 前 民生皇协军| 前 SenseTime ansible 研究院首席研究员| 前 QingCloud Top 50 研发

北京

Joined December 2012

Don't wanna be here?

Send us removal request.

Explore trending content on Musk Viewer

الهلال

• 621356 Tweets

River

• 262089 Tweets

Dubois

• 109012 Tweets

Román

• 94325 Tweets

Michigan

• 93493 Tweets

Romero

• 81875 Tweets

Riquelme

• 75316 Tweets

Gallardo

• 73411 Tweets

#precure

• 53768 Tweets

Oklahoma

• 47930 Tweets

#仮面ライダーガヴ

• 34992 Tweets

Iowa

• 31536 Tweets

Tennessee

• 31397 Tweets

Janet Jackson

• 29833 Tweets

秋分の日

• 29210 Tweets

秒速5センチメートル

• 25399 Tweets

Auburn

• 21954 Tweets

#ブンブンジャー

• 17714 Tweets

ショウマ

• 12880 Tweets

Usyk

• 11205 Tweets

ダブルドライバー

• 11162 Tweets

Last Seen Profiles

也尝试分析了一下这个问题,虽然我中间踩了不少的坑。但是交给kimi的话就直接给秒了。

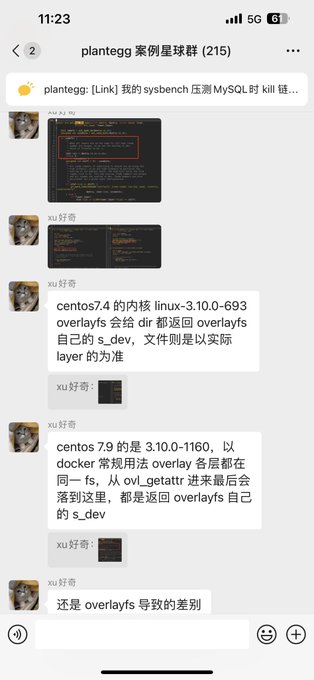

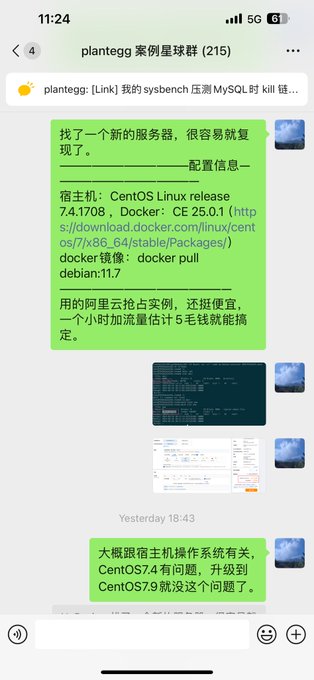

昨天遇到了一个操作系统结合虚拟化的问题,在docker中创建文件夹(dir)和创建文件(touch)所属的device(stat命令)不一致,复现了是系统的差异,今天就有小伙伴从源码层面找出来了具体的原因。所以加入

@plantegg

星球不仅仅可以学深入底层的知识,还可以有一群很厉害的人与你一起学习帮你解决问题。

3

1

24

2

0

17

@laixintao

这个bug依赖于openat2这个调用,如果没有的话则不会触发。可以提前看一下。复现的过程中网友还提供了个小技巧直接–w /proc/self/fd/xxx挂载proc命令,这样不用构建镜像了

0

0

7

周五

@haoqixu_0o0

老师帮忙测了下eg 大体上1万规则生效时间在5min左右,我都惊了。期待优化的文章。😜

1

3

4

@scnace

@VincentMucid

@ctengctsh

@flaneur2023

@plantegg

我是管集群的小卡拉米,需要预防类似的事件。出问题的集群在海外规模小,业务还在初期。如果国内也出现这种问题,我可能就要卷铺盖走人了,都是生活所迫。😭

2

0

4

@Sleepy93216599

最近在用tailscale,感觉还挺好有用的p2p打洞成功率非常高。自己有公网ipv4基本100%成功。双方都有ipv6也是100%成功。基本上能把家里上行的30多M带宽打满。

1

0

4

@ctengctsh

@flaneur2023

@plantegg

实际上我确实是这么做的。我第一时间推给厂商看了。但是根本不解决任何问题。英文也搜了。并没有现成结论。我属于是躺平派但凡有一点办法我都不会自己查。😩求大佬轻喷。

0

0

3